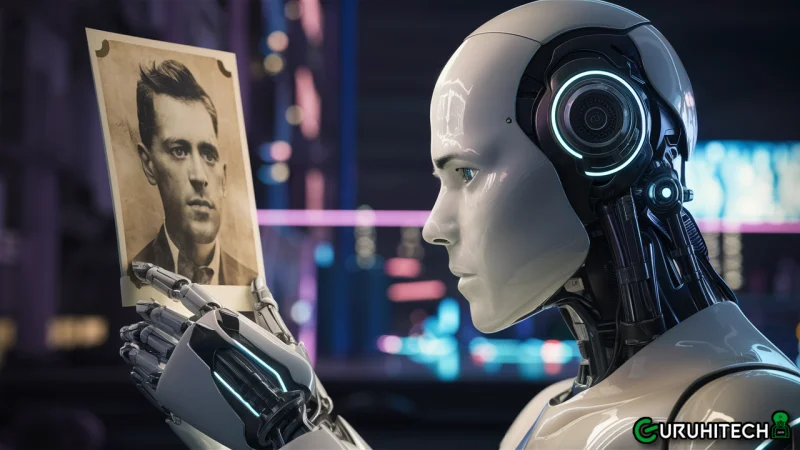

Big Brother digitale: l’IA che conosce tutto di te da una foto

Secondo lo psicologo Michal Kosinski, ricercatore presso l’Università di Stanford, è stato sviluppato un modello di intelligenza artificiale in grado di determinare caratteristiche come intelligenza, preferenze sessuali e opinioni politiche semplicemente analizzando il volto di una persona.

Questa ricerca ha sollevato numerose preoccupazioni etiche nella comunità scientifica. Alcuni la paragonano alla frenologia, la pseudoscienza ottocentesca che cercava di stabilire una connessione tra i tratti fisionomici e le capacità mentali. Kosinski, tuttavia, sostiene che il suo lavoro debba essere visto come uno strumento di previsione, piuttosto che di discriminazione.

Leggi anche:

Inoltre, nel 2021, Kosinski ha sviluppato un modello di riconoscimento facciale in grado di identificare le opinioni politiche di una persona con una precisione del 72%. Inoltre, nel 2017, lui e i suoi colleghi avevano pubblicato uno studio in cui il loro sistema riusciva a prevedere l’orientamento sessuale con una precisione del 91%, il che ha attirato pesanti critiche da organizzazioni per i diritti LGBTQ+ come la Human Rights Campaign e la GLAAD.

Tuttavia, molti scienziati sono scettici riguardo a questi risultati. In particolare, essi temono che la ricerca di Kosinski possa diventare la base per lo sviluppo di strumenti discriminatori. Allo stesso tempo, bisogna considerare che i modelli di riconoscimento facciale non sono perfetti e possono portare a identificazioni errate.

Nonostante ciò, la controversa ricerca di Kosinski solleva importanti interrogativi sull’etica dell’utilizzo dell’intelligenza artificiale per dedurre informazioni personali dalle caratteristiche fisiche delle persone. Il dibattito è quindi aperto sulla liceità e sui potenziali rischi di tali tecnologie predittive basate sull’aspetto.

Questa controversa ricerca solleva importanti interrogativi sull’etica dell’utilizzo dell’intelligenza artificiale per dedurre informazioni personali dalle caratteristiche fisiche delle persone. Il dibattito è aperto sulla liceità e sui potenziali rischi di tali tecnologie predittive basate sull’aspetto.

Ti potrebbe interessare:

Segui guruhitech su:

- Google News: bit.ly/gurugooglenews

- Telegram: t.me/guruhitech

- X (Twitter): x.com/guruhitech1

- Bluesky: bsky.app/profile/guruhitech.bsky.social

- GETTR: gettr.com/user/guruhitech

- Rumble: rumble.com/user/guruhitech

- VKontakte: vk.com/guruhitech

- MeWe: mewe.com/i/guruhitech

- Skype: live:.cid.d4cf3836b772da8a

- WhatsApp: bit.ly/whatsappguruhitech

Esprimi il tuo parere!

Che ne pensi di questa notizia? Lascia un commento nell’apposita sezione che trovi più in basso e se ti va, iscriviti alla newsletter.

Per qualsiasi domanda, informazione o assistenza nel mondo della tecnologia, puoi inviare una email all’indirizzo [email protected].

Scopri di più da GuruHiTech

Abbonati per ricevere gli ultimi articoli inviati alla tua e-mail.