Controllare il “pensiero” dell’IA? Ora è possibile (e senza riaddestrarla)

Un team del laboratorio di ricerca di T-Bank ha appena compiuto un passo che potrebbe rivoluzionare il modo in cui interagiamo con l’intelligenza artificiale. Non si tratta solo di capire cosa succede nella “testa” di un modello linguistico di grandi dimensioni (LLM), ma addirittura di pilotarne i pensieri – senza modificarne l’architettura né sottoporlo a un nuovo addestramento. La scoperta è stata presentata all’ICML 2025 in Canada, una delle conferenze più importanti al mondo nel campo del machine learning.

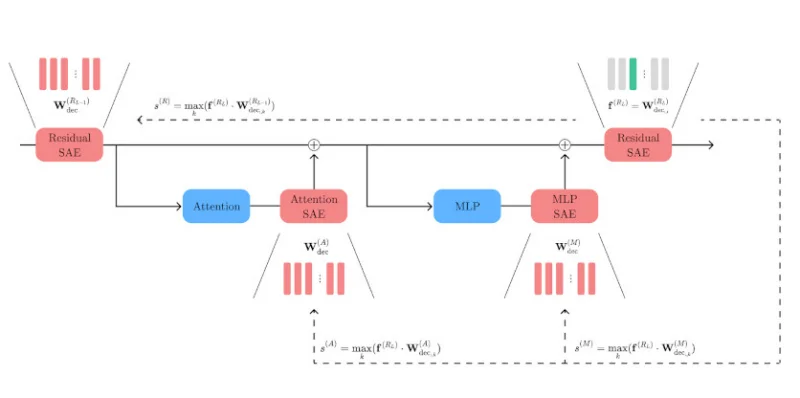

Il cuore della novità è un metodo chiamato SAE Match, in grado di tracciare con precisione come si manifestano, si modificano o scompaiono elementi semantici come tono, stile o tema all’interno del modello neurale. Una sorta di mappa del pensiero dell’IA, che rende visibile – e modificabile – il flusso d’informazioni nei suoi strati più profondi.

Non più solo osservare, ma intervenire

Fino ad oggi, i metodi interpretativi servivano solo a rispondere alla domanda “perché il modello ha dato questa risposta?”. Oggi invece, grazie a SAE Match, i ricercatori possono intervenire attivamente sul comportamento dell’IA: rafforzare o sopprimere certe caratteristiche testuali, influenzare lo stile di scrittura, filtrare argomenti specifici. Tutto questo senza toccare il modello originario.

Un’applicazione concreta? Escludere in anticipo temi indesiderati in un chatbot, ad esempio per evitare che si tocchino argomenti sensibili o inappropriati. Oppure garantire che un assistente virtuale adotti sempre uno stile coerente con il contesto (formale, amichevole, tecnico, ecc.).

Leggi anche:

Multi-intervento, massimo controllo

Una delle scoperte più promettenti riguarda la possibilità di intervenire simultaneamente in più punti del modello, ottenendo risultati migliori e senza compromettere la qualità del testo generato. Non solo: questo metodo funziona su modelli già addestrati, non richiede dati aggiuntivi ed è abbastanza leggero da essere adottato anche da piccoli team di ricerca.

Verso un’intelligenza artificiale più trasparente ed etica

Con SAE Match, non solo possiamo osservare come pensa l’IA, ma possiamo guidarla consapevolmente. Questo rappresenta un passo decisivo verso modelli linguistici più sicuri, più controllabili e più etici. E apre la porta a nuove possibilità in ambiti come la moderazione dei contenuti, l’educazione, la medicina e l’interazione uomo-macchina.

Insomma, la rivoluzione dell’intelligenza artificiale non si gioca più solo sulla potenza computazionale o sulla quantità di dati, ma anche sulla capacità di capire e indirizzare ciò che l’IA fa sotto il cofano. E da oggi, farlo è un po’ meno un mistero.

Ti potrebbe interessare:

Segui guruhitech su:

- Google News: bit.ly/gurugooglenews

- Telegram: t.me/guruhitech

- X (Twitter): x.com/guruhitech1

- Bluesky: bsky.app/profile/guruhitech.bsky.social

- GETTR: gettr.com/user/guruhitech

- Rumble: rumble.com/user/guruhitech

- VKontakte: vk.com/guruhitech

- MeWe: mewe.com/i/guruhitech

- Skype: live:.cid.d4cf3836b772da8a

- WhatsApp: bit.ly/whatsappguruhitech

Esprimi il tuo parere!

Che ne pensi di questa notizia? Lascia un commento nell’apposita sezione che trovi più in basso e se ti va, iscriviti alla newsletter.

Per qualsiasi domanda, informazione o assistenza nel mondo della tecnologia, puoi inviare una email all’indirizzo [email protected].

Scopri di più da GuruHiTech

Abbonati per ricevere gli ultimi articoli inviati alla tua e-mail.