I veri pericoli del deepfake spiegati da Damian Wilson

Un giornalista di rt.com fa un analisi ineccepibile di questo fenomeno tecnologico dai risvolti alquanto preoccupanti.

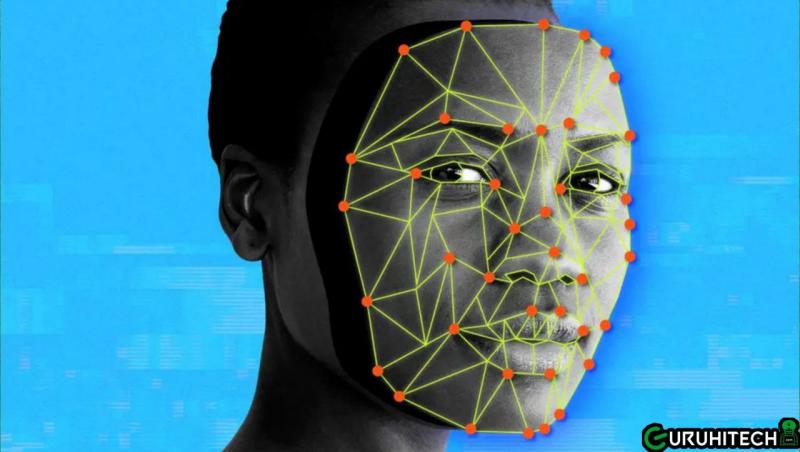

Il Deepfake come ben saprai, è una nuova tecnologia ad intelligenza artificiale, che ti consente di sostituire il volto di una persona con quello di un’altra, sia esso maschile o femminile. Con i software appositi, è possibile fare di tutto; puoi sostituire il volto di Silvester Stallone con il tuo e diventare il nuovo Rocky o puoi fare uno scherzo a qualcuno sostituendo il volto di un politico con quello di un tuo amico.

Le opportunità del deepfake sono molteplici ma come ho fatto notare in un vecchio articolo, ma ciò non toglie che l’uso che se ne può fare potrebbe avere risvolti a dir poco preoccupanti.

Damian Wilson, un giornalista del sito rt.com, ha elencato le sue preoccupazioni in un articolo che ci tengo a riportare in quanto mi è sembrato molto interessante.

Deepfake incredibilmente realistici e shallowfake scadenti rivelano salti quantici nella tecnologia che hanno il potenziale per causare caos, ma il nuovo libro “Trust No One” trova che tempo e denaro sono la chiave per tenere a freno la falsa “realtà” – per ora.

Tornando agli albori di Adobe Photoshop, come giornalista che lavorava nella stampa di sgombero, io e i miei colleghi eravamo soliti esercitare le nostre menti sulle infinite possibilità di distorcere le notizie e ridere prendendo in giro immagini false e affiancando una storia.

La nuova fotografia a manipolazione digitale è stata utile non solo per rimuovere macchie, rughe e occhi rossi dalle tante modelle in topless glamour che popolavano le pagine dell’ormai defunto Sunday Sport, ma è stata anche fondamentale per realizzare l’accompagnamento pittorico di uno dei più famosi red-top titoli nella storia quotidiano britannico: ‘World War 2 Bomber trovato sulla Luna.’ Ed eccolo lì, un bombardiere Lancaster parcheggiato in un cratere sotto gli occhi di tutti. Dimostra solo che era falso.

Nella massima segretezza ho commissionato e ritirato l’immagine da una delle nuove case di design che erano sorte a Londra offrendo servizi digitali mai visti prima all’industria della stampa, a un prezzo elevato. Abbiamo pagato £ 3.000 per l’unica foto in bianco e nero di un aereo sulla Luna che al giorno d’oggi un bambino esperto di computer impiegherebbe solo pochi minuti per produrre e stampare sul proprio getto d’inchiostro.

Non che sarebbero interessati a tali sforzi dell’età della pietra, quando hanno app sui loro smartphone come Reface, strumenti open source come DeepFaceLab e influencer virtuali completamente artificiali come Aliona Pole che fanno sembrare il nostro inganno al Sunday Sport goffo, amatoriale e decisamente così l’ultimo secolo.

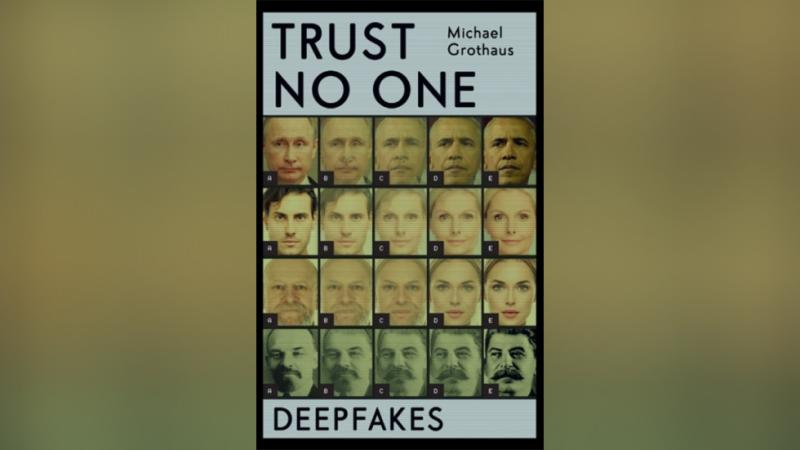

E dovresti essere d’accordo. Puoi caricare il tuo selfie su Reface e in pochi minuti trasformarti in The Rock, James Bond o Hannibal Lecter, il cosiddetto “fancasting” nei trailer dei film con sorprendente realismo. È divertente usare algoritmi che associano le tue caratteristiche a quelle di una star di Hollywood. Roba intelligente che ti fa pensare che forse il giornalista Michael Grothaus ha ragione a intitolare il suo nuovo libro “Trust No One: Inside the World of Deepfakes”.

Perché sottolinea che mentre la potenza di calcolo di uno smartphone limita la risoluzione e il potenziale dei falsi (di apprendimento) profondi, carica DeepFaceLab sul tuo PC e il cielo, o forse la luna, è il limite.

Grothaus guarda probabilmente al deepfake più avanzato di tutti, l’incredibile video messo insieme dalle media artist Francesca Panetta e Halsey Burgund che mostra una versione alternativa degli eventi, dal titolo “In Event of Moon Disaster”. Presenta l’ex presidente Richard Nixon che apparentemente legge un discorso che è stato scritto per lui, ma mai pronunciato, se la missione Apollo del 1969 sulla Luna fosse finita in tragedia.

Leggi anche:

Usando il video di un’autentica apparizione di Nixon – le sue dimissioni televisive del 1974 – i due artisti hanno filmato un attore che leggeva il discorso e poi il movimento della sua bocca, delle labbra e dei muscoli facciali sono stati mappati su Nixon in modo così esperto che è impossibile vedere le cuciture.

Ma quella era solo metà dell’esercizio. Per eseguire l’acrobazia, hanno anche analizzato e smantellato il caratteristico modo vocale di Nixon, suono per suono, in modo che potesse essere sovrapposto all’audio dell’attore per simulare il presidente morto da tempo che leggeva un discorso ad alta voce quando in realtà, che mai accaduto. E ha funzionato perfettamente e mostra con inquietante autenticità esattamente ciò che è possibile.

Certo, per produrre qualcosa di così buono ci sono voluti tempo, denaro e buona volontà. E mentre gli individui potrebbero faticare a trovare la potenza di calcolo, il tempo e il denaro per produrre efficacemente qualcosa di simile alla qualità di “In Event of Moon Disaster”, potrebbero esserci cattivi attori là fuori, stati nazionali con un’inclinazione maliziosa, ad esempio, che potrebbe sfruttare questa tecnologia.

E se una trasmissione televisiva apparentemente autentica mostrasse il dittatore nordcoreano Kim Jong-un che annunciava di aver appena lanciato un missile nucleare contro il Giappone? Sembra il Leader Supremo, suona come il Leader Supremo, abbiamo il tempo di dimostrare che non è lui o tutti a Tokyo dovrebbero mettersi al riparo e aspettare l’apocalisse o bombardare Bejesus fuori da Pyongyang in questo momento?

I deepfake rendono difficile dirlo, ma sono costosi e come quando qualcuno crea qualcosa di impressionante su Internet, vorranno dirlo a tutti alla prima occasione che hanno.

Come trova Grothaus, anche gli sforzi più basilari possono avere un effetto clamoroso. Guarda il lavoro dello YouTuber Skitz4twenty che, senza niente di meglio da fare, ha creato “The Hillary Song”, un mash-up che ha realizzato utilizzando due video separati, uno con Dwayne Johnson quando era un wrestler noto come The Rock che arrostiva oscenamente uno dei gli amministratori dello sport e l’altro dell’ex aspirante presidenziale e FLOTUS Hillary Clinton che fa un discorso.

Unisce i due insieme, a volte in modo approssimativo, quindi sembra che The Rock stia insultando Clinton. Là. Niente di più. Ha creato quello che è noto come un veloce “falso superficiale”. Eppure più di 3,5 milioni di persone hanno visto “The Hillary Song”, con centinaia di migliaia convinti che ciò che stanno guardando sia realmente accaduto e che The Rock fosse un repubblicano convinto, nonostante avesse implicitamente approvato i Democratici nelle ultime elezioni.

Leggi anche:

Quindi la malizia può costare poco. E cattivo. Perché come tante su Internet, la pornografia ha inevitabilmente sfruttato i progressi tecnologici che hanno dato origine ai deepfake. I fan tristi incollano i volti delle loro attrici di Hollywood preferite su quelli delle pornostar e immaginano chissà cosa mentre lo fanno, il cielo non voglia. In modo inquietante, è la giovane star di “Harry Potter” Emma Watson che appare in modo sproporzionato in questa particolare produzione.

E poi questo può dar luogo alla creazione di revenge porn o addirittura revenge crime, dove il volto di una persona viene incollato sul volto di un’altra che commette un atto illegale e così via. Pensa a qualcosa, trova un’immagine della tua vittima e un video di destinazione, quindi mappa i due insieme e il gioco è fatto! Sei un genio del male con un amico in meno.

È un’altra di quelle tane di coniglio di Internet, in cui persino Grothaus si ritrova a cadere. Il suo libro si conclude con lui che racconta come ha commissionato un video deepfake di suo padre, morto due decenni fa, che lo raffigura mentre si gode la tecnologia video di uno smartphone che doveva ancora arrivare quando era in vita. Aveva il viso di suo padre mappato sul video di un perfetto sconosciuto che passeggiava in un parco. È un’indulgenza triste, sentimentale e innocua per l’autore che sente la mancanza di suo padre, ma anche lui si rende conto che c’è qualcosa che non va nell’inventare questa sorta di ‘realtà’.

Dà origine all’effetto “valle perturbante”, ovvero quando la risposta emotiva a un’immagine oa un video è colpita da qualcosa che non va proprio bene. Guarda Aliona Pole, l’influencer virtuale artificiale, o gli avatar Zoom offerti da Pinscreen per essere il te perfetto per quelle noiose videochiamate e capirai subito cosa intendo.

Questo è un filtro innato che la maggior parte di noi sembra possedere e che, unito al buon senso, ci dice che qualcosa non è come potrebbe apparire. Sicuramente ci sono un sacco di tirapiedi là fuori pronti a credere a tutto ciò che vedono su Internet, ma, per il momento, il resto di noi può dire quando ci stanno facendo tirare la gamba.

Per ora, fino a quando la tecnologia non ci supererà e poi, in effetti, la posizione predefinita potrebbe essere quella di non fidarsi di nessuno.

Ti potrebbe interessare:

Segui guruhitech su:

- Google News: bit.ly/gurugooglenews

- Telegram: t.me/guruhitech

- X (Twitter): x.com/guruhitech1

- Bluesky: bsky.app/profile/guruhitech.bsky.social

- GETTR: gettr.com/user/guruhitech

- Rumble: rumble.com/user/guruhitech

- VKontakte: vk.com/guruhitech

- MeWe: mewe.com/i/guruhitech

- Skype: live:.cid.d4cf3836b772da8a

- WhatsApp: bit.ly/whatsappguruhitech

Esprimi il tuo parere!

Che ne pensi di questo articolo di Damian Wilson riguardante la tecnologia del deepfake? Lascia un commento nell’apposita sezione che trovi più in basso e se ti va, iscriviti alla newsletter.

Per qualsiasi domanda, informazione o assistenza nel mondo della tecnologia, puoi inviare una email all’indirizzo [email protected].

Scopri di più da GuruHiTech

Abbonati per ricevere gli ultimi articoli inviati alla tua e-mail.

You’re so awesome! I don’t believe I have read a single thing like that before. So great to find someone with some original thoughts on this topic. Really.. thank you for starting this up. This website is something that is needed on the internet, someone with a little originality!

Thank you Jaylen 🙂